0 引 言

无人机射频信号识别,又称无人机射频指纹识别,是一种通过处理接收到的无人机射频信号并根据信号中特有的指纹特征来识别无人机的方法[1]。该方法具有隐蔽性强、环境依赖性低、可靠性高等优点[2],因此在反无人机作战[3]、反走私活动[4]、民航空中交通管理[5]、维护公共安全[6]等多个军事和民用领域有着广阔的应用前景。

目前,无人机射频信号识别方法可分为基于时域特征的方法、基于频域特征的方法和基于时频特征的方法。基于时域特征的方法具有对突发信号敏感、计算复杂度低的优点,但该方法在低信噪比情况下的识别效果差。文献[7]提出了基于两步分数聚合方法的多分类器对采集到的I/Q 信号进行分类,提升了识别的准确率,但未对不同信噪比情况开展研究。

基于频域特征的方法相较于直接从时域波形提取特征的方法其鲁棒性更强[8]。文献[9]通过快速傅里叶变换(FFT)将一维时域射频信号转换为频域图谱并使用深度神经网络(DNN)识别无人机的型号与飞行模式。文献[10]在继承了文献[9]的信号处理方法的基础上提出了利用一维卷积神经网络(1D CNN)对无人机射频信号进行识别,提升了准确率。但由于上述方法只保留了信号的频域信息,舍弃了时域信息,因此在多类型无人机情况下的识别效果差。

基于时频特征的方法能够同时保留无人机射频信号在时域和频域上的特征信息,因此识别准确率和鲁棒性更高,亦是当前主流的无人机射频信号识别方法。文献[11]利用双谱分析将一维无人机时域信号转换为二维双谱图,并提出了双谱孪生(Bispectrum Siamese, BisSiam)网络,实现了对无人机的型号与飞行模式的识别。但由于双谱分析方法只能结合信号的相位信息和频域信息,对时域特征信息的表现不直接,导致特征提取难度大,进而使得在飞行模式识别任务上的精度较低。文献[12]通过短时傅里叶变换将无人机射频信号转换为时频图的形式并利用残差网络实现了特征提取和信号识别,但该模型在低信噪比条件下难以提取有效的时频特征且参数量大不利于部署和应用。文献[13]提出了基于多分支卷积结构以及卷积注意力模块(Convolutional Block Attention Module, CBAM)的射频信号识别模型,提升了在复杂电磁环境下的检测精度,但其模型的计算量较大,且不支持对无人机飞行模式的识别。

基于上述讨论,无人机射频信号识别技术存在低信噪比环境下型号和飞行模式识别精度低,且模型计算量较大不利于实际部署和应用的问题。为此,本文首先通过变分模态分解和短时傅里叶变换方法过滤时域射频信号的部分噪声,并将其转换为时频图用于特征提取和信号识别。然后,以MobileNetv4模型为基础进行优化,解决了在低信噪比识别精度低和计算资源占用多的问题。最后,实验结果表明本文所提方法在复杂电磁环境下对无人机型号和飞行模式识别效果有显著提升。

1 射频信号的预处理与时频分析

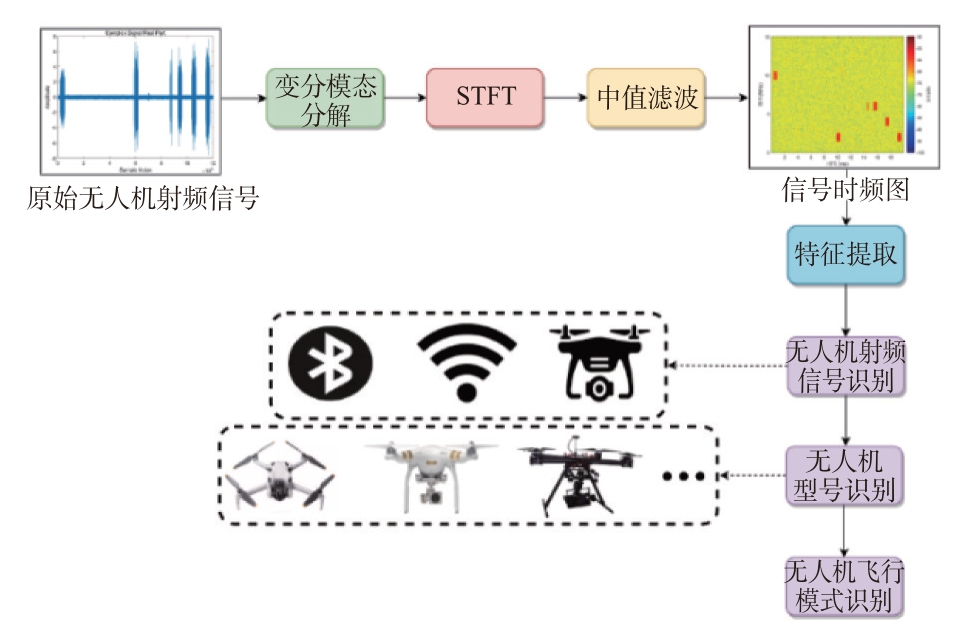

为实现对无人机的射频信号和飞行模式的识别,本文提出了如图1所示的射频信号处理和识别流程。该流程主要包括以下步骤:首先,利用变分模态分解(Variational Mode Decomposition, VMD)对无人机射频信号的一维时域波形进行分解滤波,旨在突显出该信号的高频分量,抑制有效频段的周边干扰。并对分解滤波后的信号进行短时傅里叶变换(Short-Time Fourier Transform, STFT)得到信号时频特征的二维数值矩阵。然后,对该二维数值矩阵采用中值滤波降低背景噪声的干扰,得到信号时频图。最后,利用MobileNet-DOA 模型对时频图进行特征提取和分类,实现对无人机信号和飞行模式识别。

图1 无人机射频信号识别流程图

1.1 基于VMD的信号预处理

为解决在复杂电磁环境下无人机射频信号子带周边存在干扰,从而降低信号识别准确率的问题,本文引入VMD 方法[14]实现对干扰信号的有效滤除。VMD 方法源于经验模态分解(Empirical Mode Decomposition,EMD)方法[15],该方法根据分量中心频率构造Winener 滤波器,利用迭代搜索变分模型最优解,确定每个固有模态函数(IMF)中心频率及带宽[16],弥补了EMD 易发生模式混叠且缺乏严格数学理论基础的缺点。

VMD 的主要思想是构造和求解变分问题,其主要步骤如下。

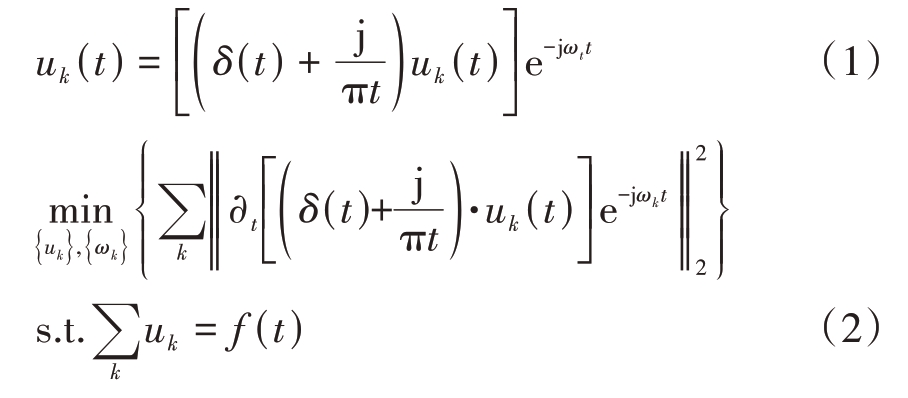

步骤1 对于无人机射频时序信号f(t),变分问题可构造为

式中,k 为IMF 数量,uk ={u1, u2,…, uk}和ωk ={ω1, ω2,…, ωk}分别是模态集合和中心频率集合。

步骤2 引入惩罚因子α 和拉格朗日算子λ(t)消除式(2)的约束条件

步骤3 利用交替方向乘子算法(ADMM)迭代式(3)中μk、ωk、λ,每一轮迭代遵循下式:

式中,n为迭代次数,τ为更新参数。

步骤4 设定最大迭代次数为N,使得n ≤N,存在任意ε > 0满足下式:

当式(7)条件成立时,即可得到k 个IMF。对于本文所采用的无人机射频信号,设置k=10,经过VMD 分解后选取前4 个含有信号主成分的IMF 合成为新的一维时域波形信号,该信号是后续STFT变换的输入信号。

1.2 基于STFT的时频分析

为将预处理后的一维时域波形信号转换为二维时频图形式的MobileNet-DOA 模型输入,本文采用基于STFT 的时频分析方法获取信号的时频图,同时引入中值滤波抑制了时频图中的背景噪声。

设经VMD 处理后的信号为y(t),分析频率点为N,时间点为T,则通过式(8)得到反映信号时频特征的二维数值矩阵ŷ∈ℝN × T。

式中,n = 1,2,…,t = 1,2,…,g(τ)为窗函数。该二维数值矩阵ŷ∈ℝN × T 含有相当的背景噪声影响后续模型的识别精度,针对这一问题本文使用了中值滤波,可用下式表示:

式中,G(N,T)为输出时频图,W为滤波模板。

对于本文所采用的无人机射频信号,其STFT变换窗口长度选取为2 048,复信号片段截取选取为2.5 × 10-4 s,窗函数选用汉明窗,滤波模板大小a,b均为4。

图2 展示了同一段射频信号在信号处理各个阶段的时频图。对比图2(a)和图2(b)可以观察到VMD 滤除了目标信号周围的干扰,突显了不同分量的窄带性,同时在一定程度上削弱了背景噪声,使得目标信号更突出,但仍存在大量的颗粒状噪声会对信号识别产生不良影响。对比图2(b)和图2(c)可见中值滤波操作可有效消除背景中的颗粒噪声,进一步提升了降噪效果。

图2 各个阶段时频图

2 MobileNet-DOA模型

为实现对无人机型号和飞行模式的识别,同时还要考虑到模型部署和实时运算的便捷性,本文选择了MobileNetv4[17]作为分类器的基准模型。该模型相比于传统的基于机器学习识别信号方法识别精度更高,相较于ResNet、Transformer 等深度学习模型的训练和推理速度更快。

基于VMD的等信号预处理方法不能完全消除射频信号中存在的噪声,为此本文在MobileNetV4模型基础上引入了深度过参数化卷积(Depthwise Over-parameterized Convolutional, DOConv)[18]增强模型的特征提取效果,同时融合了FA(Feature Attention)注意力机制[19]使得模型关注于信号个体及个体之间的联系,减少背景噪声对信号识别的影响,得到了MobileNet-DOA 模型。

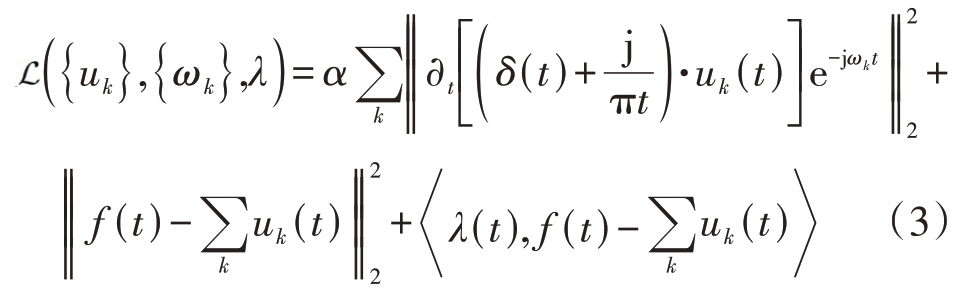

2.1 MobileNet-DOA 网络结构

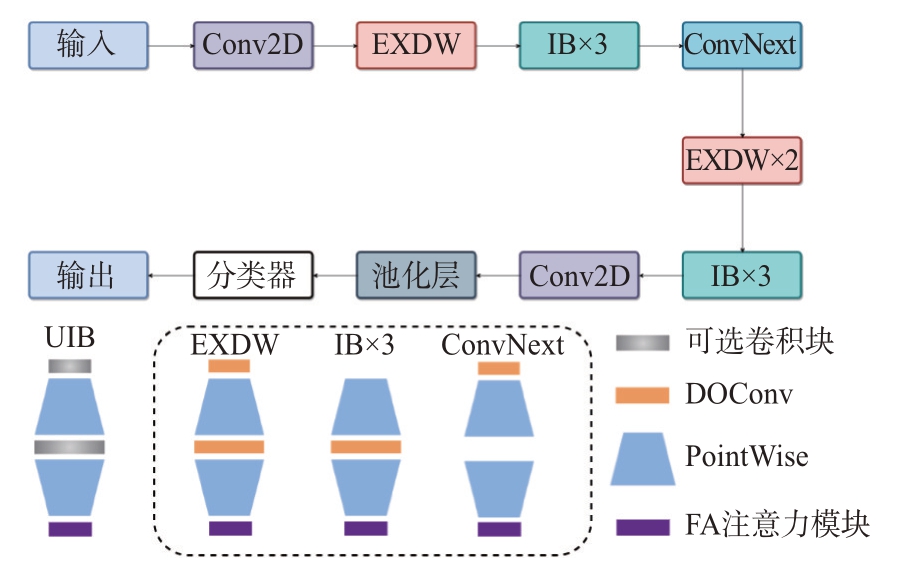

MobileNet-DOA 模型的网络结构如图3 所示,该模型主要由特征提取部分、池化层和分类器三部分构成。首先,输入端作为模型时频图的输入口,为模型提供初始数据层。然后,特征提取部分将原始时频数据映射到高位特征空间实现对关键时频特征的提取。特征提取部分由常规二维卷积、EXDW 模块、IB 模块和ConvNext 模块组成,其中EXDW 模块、IB 模块和ConvNext 模块均由通用倒置颈结构(Universal Inverted Bottleneck,UIB)派生而来。通用倒置颈结构引入了两个DOConv 卷积块,一个位于逐点(PointWise)扩展层之前,另一个位于扩展层和投影层之间,同时在尾部引入FA注意力模块旨在抑制背景噪声对信号识别的干扰。基于通用倒置颈结构组建信号识别网络的特征提取模块使得MobileNet-DOA 模型在保证模型轻量化和高效性的同时,又具备更强的表征能力。具体来说,EXDW 模块通过更深层次的卷积操作提高了模型对信号细微时频特征的解析能力,而IB 模块和ConvNext 模块进一步优化了时频特征的压缩与扩展,使得模型在拥有较低参数量前提下,能够更有效地捕捉信号中的关键特征。

图3 MobileNet-DOA 网络结构图

最后,在特征提取完成后,池化层对提取的信号时频特征进行降维处理以便于后续的分类处理。分类器部分利用全连接层对经过处理的特征进行分类,实现对无人机型号和飞行模式的准确识别。

2.2 DOConv卷积

在MobileNetv4 模型中,广泛运用了深度可分离卷积(Depthwise Separable Convolution),其目的是减少模型的计算复杂度和参数数量,但该计算方法存在着限制特征通道之间信息交互的缺点[20],从而削弱模型的特征提取能力进而导致识别准确率下降。针对这一问题,本文引入了DOConv 卷积机制,在保持模型轻量化的同时,进一步提升了模型的识别准确率。DOConv 卷积是一种深度过参数化的卷积层,其核心机制是在训练阶段通过引入额外的深度卷积来增强卷积层的表现。在这种机制中,每个输入通道与不同的二维核进行卷积,得到的卷积组合虽然增加了可学习的参数,但结果可以通过线性操作表示为一个单一的卷积层。而在推理阶段,DOConv 可以被融合为常规卷积层,使得推理时的计算量与普通卷积层完全相同。

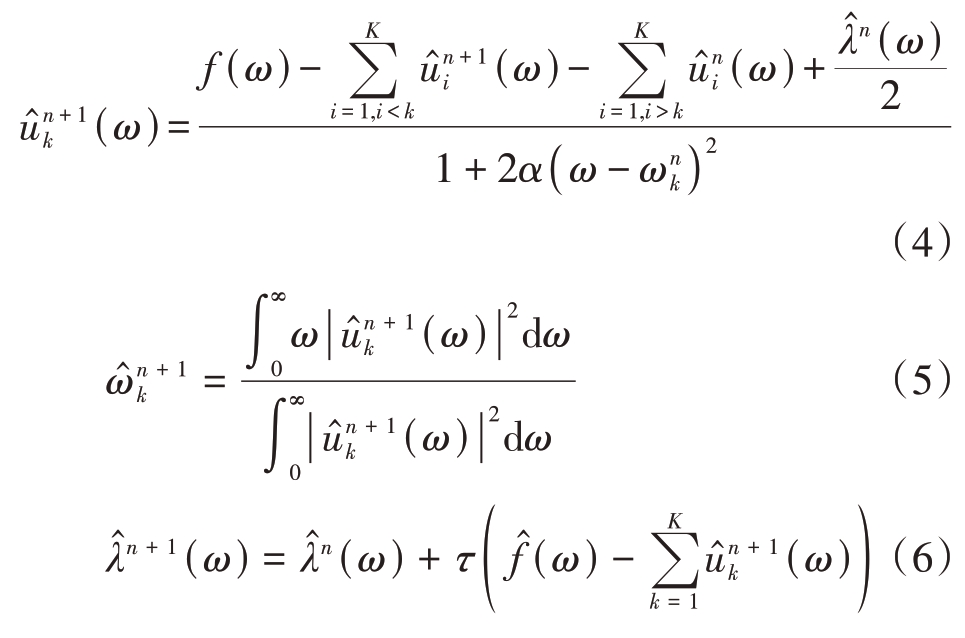

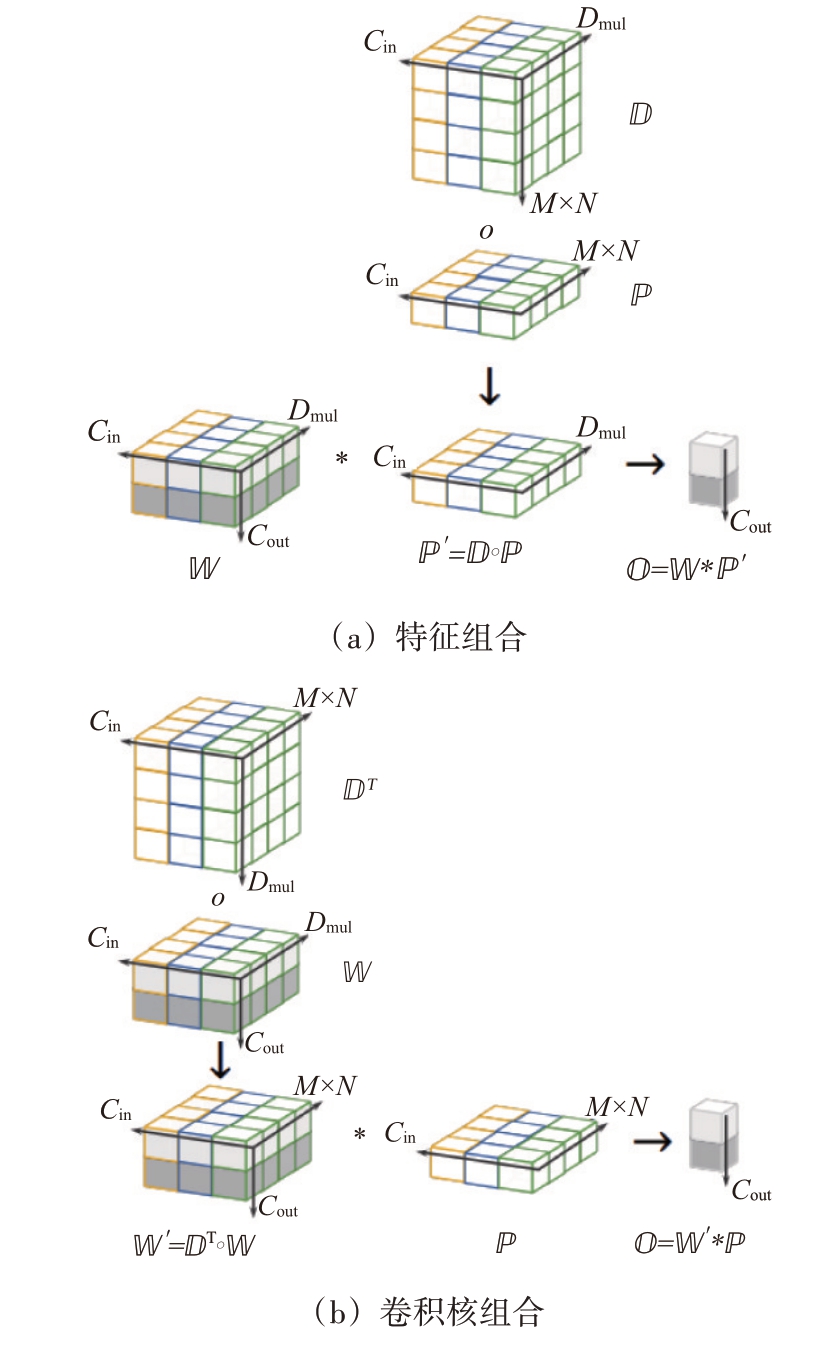

DOConv 卷积具体计算操作可以分为特征组合和卷积组合两种计算方式,示意图如图4所示。

图4 DOConv卷积操作示意图

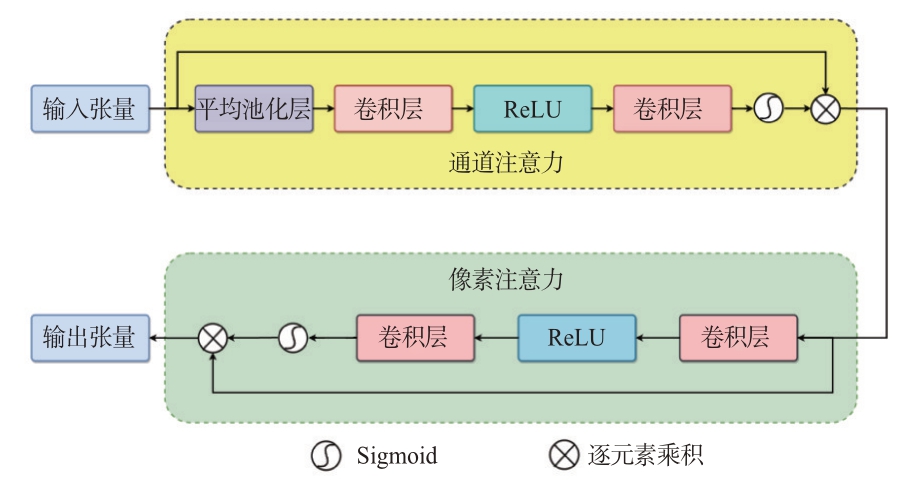

对于图4(a)的特征组合方式而言,首先将输入特征矩阵P ∈ℝM × N × Cin使用卷积核D ∈ℝM × N × Dmul × Cin进行深度卷积操作得到中间特征变量P′∈ℝM×N×Cin×Dmul,其中M 和N 为填充(Padding)后特征矩阵的高度和宽度,Cin为输入特征张量的通道数,之后将中间特征变量P′ ∈ℝ M × N × Cin × Dmul使用卷积核W ∈ℝDmul × Cin × Cout进行常规卷积操作得到结果O ∈ℝ M × N × Cout。对于图4(b)的卷积核组合方式而言,首先将卷积核D ∈ℝM × N × Cin × Dmul 进行转置处理得到D T,然后使D T与标准卷积核W ∈ℝDmul × Cin × Cout 进行深度卷积操作,得到新的卷积核W ′∈ℝM × N × Cin × Cout,最后将新的卷积核W ′∈ℝM × N × Cin × Cout 与输入特征矩阵P ∈ℝM × N × Cin进行常规卷积操作得到结果O ∈ℝM × N × Cout。

根据上述卷积操作过程可知,特征组合方法使用了两个权重:D ∈ℝM × N × Dmul × Cin和W ∈ℝDmul × Cin × Cout,且Dmul ≥M × N,而传统卷积核的参数量为Cout ×M × N × Cin,即使Dmul = M × N,DOConv 卷积参数量多于传统卷积M × N × Cin × Dmul。同时可知特征组合和卷积核组合两种方法的计算量,即

式中,H 和W 为输入特征张量的长和宽。通常地,Dmul ≥M × N 且H × W ≫Cout,因此卷积组合的方式的计算量小于特征组合的方式,且存储卷积核中间变量W′所需内存小于存储P′。

综合上述可知,DOConv 卷积的特征组合计算方式具有较高的参数量,能够在提升模型特征提取能力的同时加快训练速度,适用于模型的训练阶段;而卷积核组合计算方式拥有较低的计算量和内存占用量,适用于模型的推理阶段。

2.3 FA注意力机制

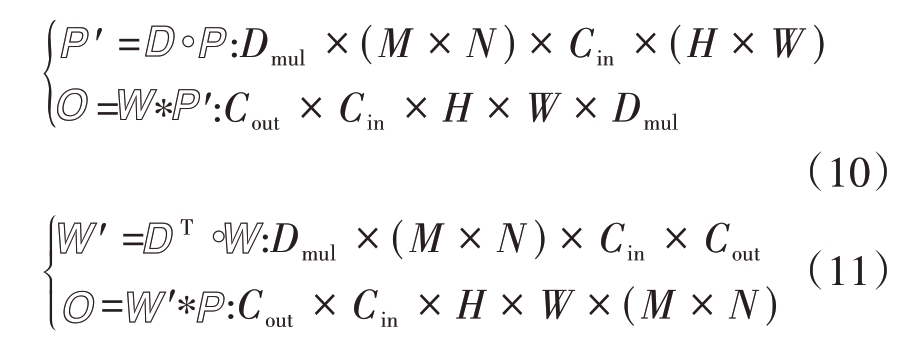

为进一步加强时频图中相关特征信息对模型推理的影响权重,同时抑制背景噪声对识别精度的干扰,本文将FA注意力机制融合到了MobileNet-DOA模型中。FA注意力的结构图如图5所示。

图5 FA注意力机制

FA 注意力模块主要由通道注意力(Channel Attention)模块和像素注意力(Pixel Attention)模块两个子模块组成。对于输入特征张量Fin ∈ℝC × H × W,通道注意力模块首先对该特征张量进行全局平均池化,得到各个通道的全局信息gc ∈ℝC × 1 × 1,公式如下:

式中,Hp为全局池化函数,Xc(i, j)为特征张量Fin在第c 个通道(i, j)的值。之后,gc 经过两个卷积层和ReLU 激活函数,最后通过Sigmoid 函数,生成通道权重CAc,公式如下:

式中,σ 为Sigmoid 函数,δ 为ReLU 激活函数。最后,将输入特征张量Fin 与生成的通道权重CAc 逐元素相乘,得到加权后的通道特征F*,公式如下:

而在像素注意力模块部分,通道特征F*经过两个具有ReLU 和Sigmoid 卷积层得到像素级别的权重图PA。

最后,将通道特征图F*与像素权重图PA 元素相乘,得到加权输出张量F͂∈ℝC × H × W。

3 实验设置

3.1 数据集

本文采用了公开无人机射频信号数据集DRDEDA[21]进行实验。该数据集包含了7 种不同类型的无人机在存在蓝牙和WIFI信号干扰环境下的射频信号,每种无人机均采集了开机、悬停和飞行三种飞行模式下的I/Q信号。数据集的采样率为60 MHz,带宽为28 MHz,中心频率为2.437 5 GHz,单样本采样时间为2 s,采样点数为1.2 × 108 个。由于单个样本是采样点数大,本文将样本均分为100个时长为20 ms 的小样本。同时为了测试不同信噪比条件下的信号识别准确率,本文按照1∶1的比例向信号样本添加信噪比范围为-15~15 dB,步长为2.5 dB 的高斯白噪声。而在数据集划分方面,本文按照7∶2∶1的比例将标注后的时频图划分训练集、验证集和测试集。

3.2 实验环境与模型参数

本文使用的CPU 为i9-10900K,GPU 为NVIDIA GeForce RTX 3080,内存为32 GB,操作系统为Windows 10,64 位,PyTorch 框架版本号为3.8,GPU加速软件为CUDA11.3和cuDNN8.0。

在模型参数方面,对于VGG16、EfficientNet-B3、ResNet-50 和MobileNet 系列模型,输入图片大小设置为500×500,初始学习率为0.000 1,batch size 为8,在50 轮后设置为4;而对于YOLOv8n-cls模型,输入图片大小设置为640×640,batch size 为16,初始学习率为0.01;为防止模型在训练过程中出现过拟合情况,以上所有模型均采用AdamW 算法作为优化器,动量设置为0.937,衰减系数设置为0.000 5,训练轮数为100轮。

4 实验结果与分析

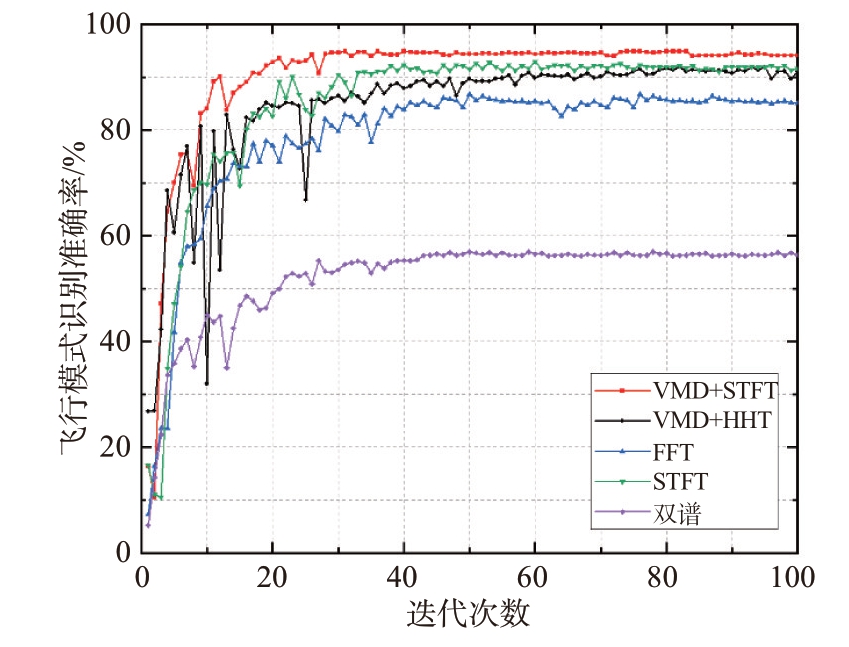

4.1 信号特征提取方法对比实验

为验证基于VMD 和STFT 方法提取无人机射频信号特征的有效性,本文选择了FFT、双谱分析、STFT、VMD+HHT 和VMD+STFT 方法进行实验验证。实验所采用的信号分类模型均为MobileNet-DOA模型,信噪比为5 dB,结果如表1和图6所示。

表1 信号特征提取方法对比实验识别准确率

信号特征提取方法FFT双谱STFT VMD+HHT VMD+STFT样本容量/张9 500 4 250 2 125 9 500 4 250 2 125 9 500 4 250 2 125 9 500 4 250 2 125 9 500 4 250 2 125识别准确率/%信号94.3 91.1 82.1 73.8 67.7 62.5 98.7 97.8 93.5 97.4 94.8 88.4 99.6 99.4 97.6型号92.7 87.5 78.4 64.4 60.3 53.8 96.8 93.7 88.4 94.4 89.1 83.3 98.6 97.3 94.7飞行模式87.4 78.8 64.6 58.3 54.5 48.3 92.3 89.5 82.2 89.7 82.7 70.5 94.2 93.3 90.2飞行模式平均76.9 53.7 88.0 80.9 92.6

图6 不同信号特征提取方法训练准确率

从表1的实验结果可以观察到,在不同样本容量条件下基于VMD+STFT 方法的信号识别准确率均高于其他四种特征提取方法,并且该方法识别准确率受样本容量影响小。通过图6 的实验结果可知:双谱分析方法在网络训练中准确率最低;FFT 方法的识别准确率相较于基于STFT 和HHT方法较低,这是因为该方法无法提取出信号的时域特征信息;HHT 方法在训练过程中的稳定性和准确率均低于基于STFT 方法;而VMD+STFT 方法相比于STFT 方法在训练过程中收敛速度更快且准确率更高。综上可见,基于VMD+STFT 方法的信号特征提取方法具有更好的识别效果。

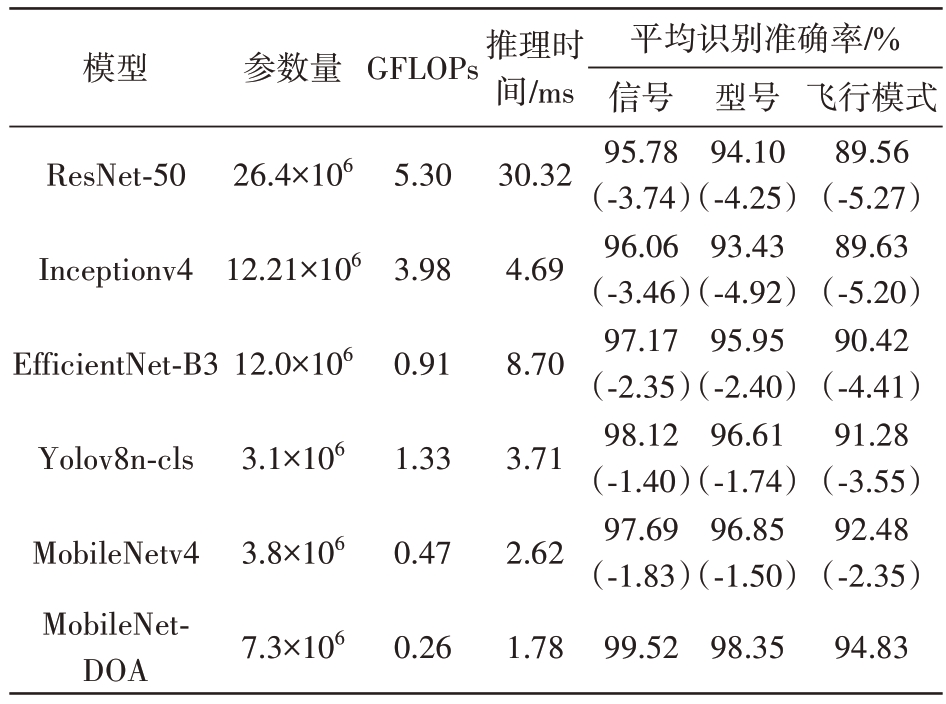

4.2 模型对比实验

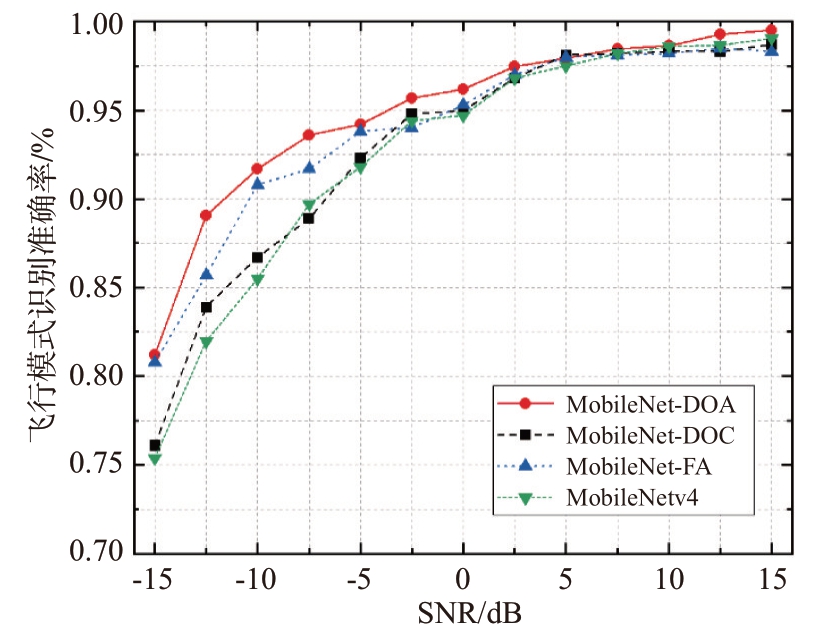

本文开展了模型对比实验,以此验证MobileNet-DOA 模型在低信噪比环境下识别无人机射频信号的有效性,参与对比实验的模型有ResNet-50[22]、Inceptionv4[23]、EfficientNet-B3[24]、Yolov8n-cls 和MobileNetv4。评价指标包括参数量、GFLOPs、推理时间以及平均识别准确率。实验结果如表2 和图7所示。

表2 模型对比实验结果

模型ResNet-50 Inceptionv4 EfficientNet-B3 Yolov8n-cls MobileNetv4 MobileNet-DOA参数量26.4×106 12.21×106 12.0×106 3.1×106 3.8×106 7.3×106 GFLOPs 5.30 3.98 0.91 1.33 0.47 0.26推理时间/ms 30.32 4.69 8.70 3.71 2.62 1.78平均识别准确率/%信号95.78(-3.74)96.06(-3.46)97.17(-2.35)98.12(-1.40)97.69(-1.83)99.52型号94.10(-4.25)93.43(-4.92)95.95(-2.40)96.61(-1.74)96.85(-1.50)98.35飞行模式89.56(-5.27)89.63(-5.20)90.42(-4.41)91.28(-3.55)92.48(-2.35)94.83

图7 不同信噪比条件下各模型的飞行模式识别准确率

从表2 的实验结果可以观察到,MobileNet-DOA 模型相较于原基准模型MobileNetv4 参数量增加了91.8%,计算量降低了44.7%,推理时间降低了32.1%,飞行模式平均识别准确率提升了2.35%。实验结果中MobileNet-DOA 模型之所以出现参数量增加、计算量和推理时间减少的现象,是因为该模型的DOConv 卷积在训练阶段使用了特征组合的方式进行卷积计算,旨在通过过参数化(Over-parameterized)的方式提升网络对信号时频特征的提取效果,同时加快收敛速度,而在推理阶段DOConv 卷积使用了卷积核组合的方式进行卷积计算使计算量降低,加快推理速度,便于在终端部署。在飞行模式平均识别准确率方面,MobileNet-DOA 模型与其他主流分类模型相比,在全信噪比(-15~15 dB)范围内的准确率有2.35%~7.32%的性能提升。

从图7的实验结果可以得知:随着信噪比的降低,信号识别准确率也随之下降。在5~15 dB 较高的信噪比条件下,大部分模型的飞行模式识别准确率均维持在95%以上,拥有较好的识别性能;而在-15~-5 dB 的低信噪比情况下,MobileNet-DOA模型的飞行模式识别准确率明显高于其他模型,且在信噪比为-15 dB 时准确率仍达到了81.2%。并且,原基准模型MobileNetv4 的性能表现优于其他主流分类模型,这是因为该模型具备通用倒置颈结构,使其能够更好地融合空间和通道特征,同时灵活调整了感受野,使得模型更有效地聚合全局信息,从而实现更准确的分类判断。综合模型对比实验的数据和分析可以得出,MobileNet-DOA模型在全信噪比条件下均能对无人机射频信号进行有效识别,且具备快速的推理速度和良好的部署能力。

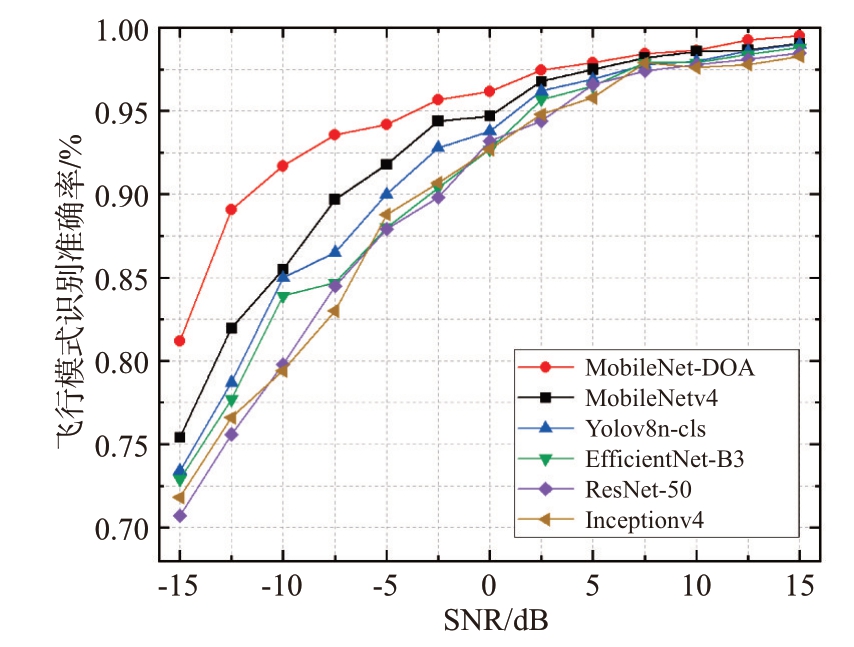

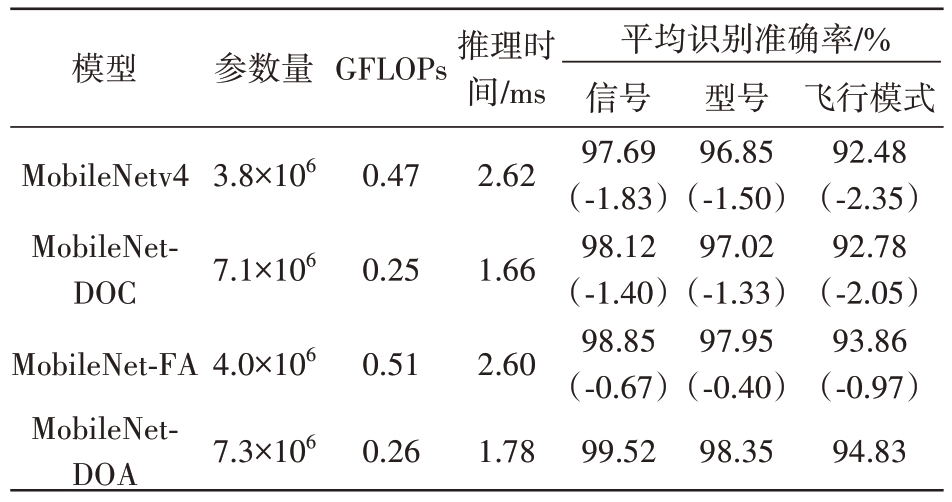

4.3 模型消融实验

为验证DOConv 卷积和FA 注意力机制在提升模型对无人机射频信号识别精度的有效性,本文开展了消融实验,旨在探究其对模型性能的具体影响。对于MobileNet-DOA 模型分别去除FA 注意力机制和替换DOConv 卷积为深度可分离卷积,得到了变种模型MobileNet-DOC 和MobileNet-FA,实验结果如表3和图8所示。

表3 消融实验结果

模型MobileNetv4 MobileNet-DOC MobileNet-FA MobileNet-DOA参数量3.8×106 7.1×106 4.0×106 7.3×106 GFLOPs 0.47 0.25 0.51 0.26推理时间/ms 2.62 1.66 2.60 1.78平均识别准确率/%信号97.69(-1.83)98.12(-1.40)98.85(-0.67)99.52型号96.85(-1.50)97.02(-1.33)97.95(-0.40)98.35飞行模式92.48(-2.35)92.78(-2.05)93.86(-0.97)94.83

图8 不同信噪比条件下消融实验结果

从表3 的实验结果可以观察到,在没有FA 注意力机制的情况下,模型的参数量、计算量和推理时间和MobileNet-DOA 模型相比没有发生明显变化,信号、型号和飞行模式平均识别准确率分别降低了1.4%、1.33%和2.05%;而在缺少DOConv 卷积的条件下,模型参数量、计算量和推理时间与原基准模型MobileNetv4相近,信号、型号和飞行模式平均识别准确率分别降低了0.67%、0.4%和0.97%。这表明两种模型改进侧重不同,DOConv 卷积主要提升了模型的训练和推理速度,而FA 注意力机制主要提升了模型的抗干扰能力。

图8 展示了在不同信噪比条件下的消融实验结果。从图中可以得知:各个模型在信噪比大于0 dB,即信号干扰强度较低的环境下,信号识别准确率均维持在较高的水平且相差不大。而在信噪比为-15~-5 dB 时,FA 注意力机制提升了模型3.685%的飞行模式平均识别精度,优于DOConv卷积的0.705%,这是因为FA 注意力机制可以有效地屏蔽时频图中的背景噪声,使有效的时频特征得到了突显,因而在低信噪比环境下的有效性增强。综上所述,单独引入DOConv 卷积可以提升模型的计算效率和推理速度,但在面对复杂的低信噪比环境时,其效果有限。而FA 注意力机制则在提升模型的抗干扰能力方面表现出色,尤其是在低信噪比条件下,可以显著提高信号识别的准确率。

5 结束语

本文提出了一种基于MobileNet-DOA 模型的无人机飞行射频信号识别方法,其目的是解决现有射频信号识别方法难以在低信噪比条件下有效检测无人机型号和飞行状态的问题。首先通过变分模态分解信号处理方法降低了目标信号子带周围和背景噪声干扰,提升了抗噪声干扰能力。之后将DOConv 卷积融合到基准信号识别模型中,增强时频特征在训练过程中的表达效果同时提升模型的推理速度。随后使用FA 注意力机制,进一步抑制模型对背景噪声区域的关注,提升其在低信噪比环境下的鲁棒性。最后在公开数据集上进行实验验证,结果证明了本文提出的无人机射频信号识别方法的有效性。

[1] 张振,贾济铖,康健,等.射频指纹识别技术方法综述[J].无线电通信技术,2021,47(3):249-258.

[2] 俞宁宁,毛盛健,周成伟,等.DroneRFa:用于侦测低空无人机的大规模无人机射频信号数据集[J].电子与信息学报,2024,46(4):1147-1156.

[3] 王波,孟志鹏,陈小庆,等.从无人机蜂群发展趋势看反无人机蜂群策略[J].国防科技,2023,44(3):68-73.

[4] SHI Xiufang, YANG Chaoqun, XIE Weige, et al. Anti-Drone System with Multiple Surveillance Technologies:Architecture, Implementation, and Challenges[J]. IEEE Communications Magazine, 2018, 56(4):68-74.

[5] 全权,李刚,柏艺琴,等.低空无人机交通管理概览与建议[J].航空学报,2020,41(1):6-34.

[6] 邴政,周良将,董书航,等.一种基于微多普勒和机器学习的无人机目标分类识别技术[J].雷达科学与技术,2024,22(5):549-556.

[7] SOLTANI N, REUS-MUNS G, SALEHI B, et al. RF Fingerprinting Unmanned Aerial Vehicles with Non-Standard Transmitter Waveforms[J]. IEEE Trans on Vehicular Technology, 2020, 69(12):15518-15531.

[8] 张涵硕,李涛,李勇朝,等.基于归一化循环前缀相关谱的无人机识别技术[J].西安电子科技大学学报,2024,51(2):68-75.

[9] AL-SA’D M F, AL-ALI A, MOHAMED A, et al. RFBased Drone Detection and Identification Using Deep Learning Approaches: An Initiative Towards a Large Open Source Drone Database[J]. Future Generation Computer Systems, 2019, 100:86-97.

[10] ALLAHHAM M S, KHATTAB T, MOHAMED A. Deep Learning for RF-Based Drone Detection and Identification: A Multi-Channel 1-D Convolutional Neural Networks Approach[C]//2020 IEEE International Conference on Informatics, IoT, and Enabling Technologies,Doha, Qatar:IEEE, 2020:112-117.

[11] LI Taotao, HONG Zhen, CAI Qianming, et al. Bissiam:Bispectrum Siamese Network Based Contrastive Learning for UAV Anomaly Detection[J].IEEE Trans on Knowledge and Data Engineering, 2021, 35(12):12109-12124.

[12] BASAK S, RAJENDRAN S, POLLIN S, et al. Drone Classification from RF Fingerprints Using Deep Residual Nets[C]//2021 International Conference on Communication Systems & Networks ,Bangalore, India:IEEE, 2021:548-555.

[13] 苏志刚,晏翔,韩冰,等.低信噪比条件下无人机射频信号实时检测方法[J].信号处理,2023,39(5):919-928.

[14] DRAGOMIRETSKIY K, ZOSSO D. Variational Mode Decomposition[J]. IEEE Trans on Signal Processing,2013, 62(3): 531-544.

[15] HUANG N E, ZHENG Shen, LONG S R, et al. The Empirical Mode Decomposition and the Hilbert Spectrum for Nonlinear and Non-Stationary Time Series Analysis[J]. Proceedings of the Royal Society of London. Series A: Mathematical, Physical and Engineering Sciences,1998(3):903-995.

[16] 王仪,许枫,杨娟.低信噪比下基于多元变分模态分解的水下蛙人特征提取[J].声学学报,2024,49(2):318-326.

[17] QIN Danfeng, LEICHNER C, DELAKIS M, et al. Mobile-NetV4-Universal Models for the Mobile Ecosystem[J].arXiv, 2024.https://doi.org/10.48550/arXiv.2404.10518.

[18] CAO Jinming, LI Yangyan, SUN Mingchao, et al. Do-Conv: Depthwise Over-Parameterized Convolutional Layer[J].IEEE Trans on Image Processing, 2022, 31:3726-3736.

[19] QIN Xu, WANG Zhiling, BAI Yuanchao, et al. FFA-Net:Feature Fusion Attention Network for Single Image Dehazing[C]//Proceedings of The AAAI Conference on Artificial Intelligence, New York, USA:AAAI Press,2020:11908-11915.

[20] CHOLLET F. Xception: Deep Learning with Depthwise Separable Convolutions[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,Honolulu, HI, USA:IEEE, 2017:1251-1258.

[21] SWINNEY C J, WOODS J C. The Effect of Real-World Interference on CNN Feature Extraction and Machine Learning Classification of Unmanned Aerial Systems[J].Aerospace, 2021, 8(7):179.

[22] HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al.Deep Residual Learning for Image Recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas, NV, USA:IEEE,2016:770-778.

[23] SZEGEDY C, IOFFE S, VANHOUCKE V, et al. Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning [C]//Thirty-First AAAI Conference on Artificial Intelligence, San Francisco, CA,USA:AAAI Press,2017:4278-4284.

[24] TAN Mingxing, LE Q V. EfficientNet: Rethinking Model Scaling for Convolutional Neural Networks[J]. arXiv,2019. https://doi.org/10.48550/arXiv.1905.11946.